ハードウェア一体化 AIプラットフォーム

N-Cube

企業の社内ナレッジをローカルで自由に扱えるAIアシスタントへ

――導入はわずか30分

動画でわかるN-Cubeのすごさ

LAN・オフライン利用可能を前提にした設計

オフライン環境や、社内LANネットワークでも

最先端のオープンソースLLMがスムーズに動作し、

データ安全性を重要視している企業に最適

trans-Nの技術で貴社の課題を解決します

サービスや代理店契約に関するお問い合わせはこちらから承っております。

または info@trans-n.org までご連絡

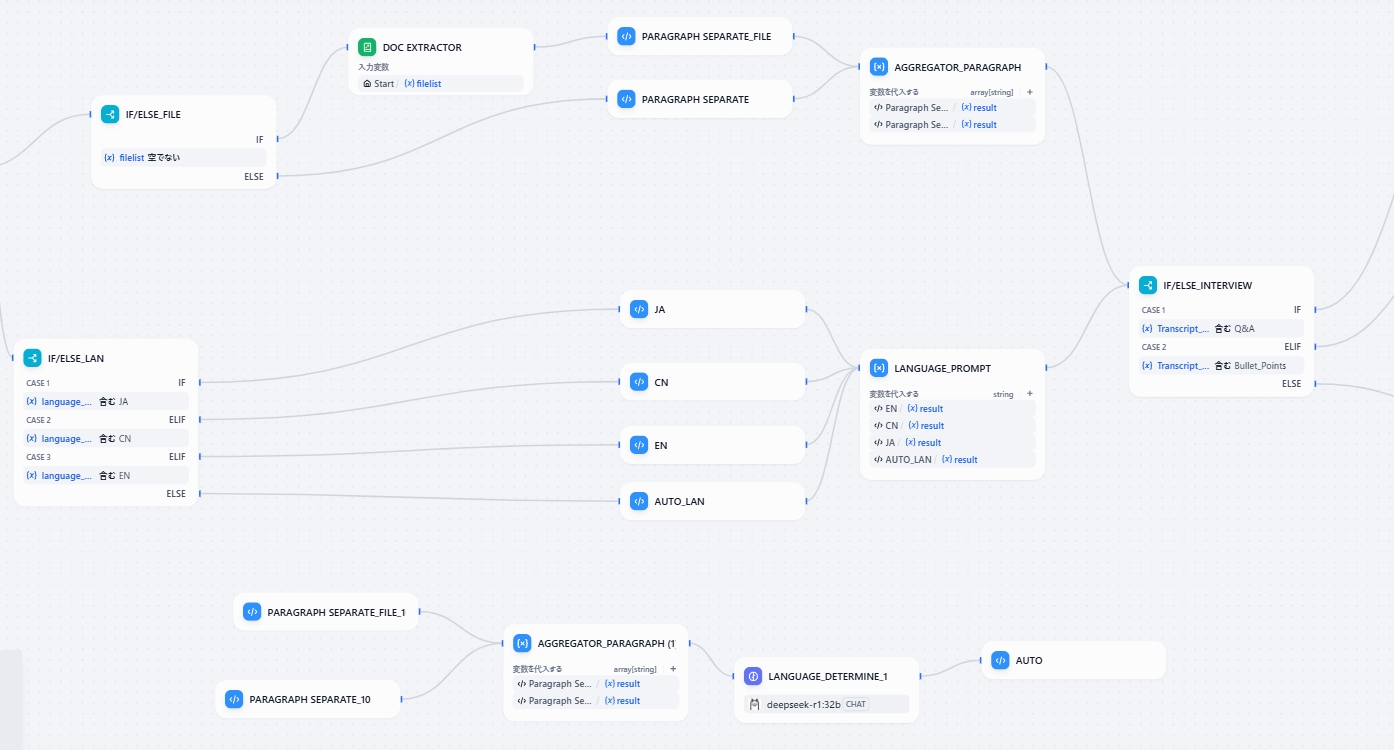

オンプレミスで学習可能なAI

推論と学習を両立

オープンソースLLMの学習済みデータを瞬時に参照し、リアルタイムで推論が可能。

SFT(指示調整学習)やRL(強化学習)により、モデルのPost-Trainingも対応。

わかりやすいUIで企業がAIに正解データ提示や出力に対するフィードバックでき、AIが企業独自の専門知識や文書スタイルを習得し、使えば使うほど企業独自のAIに進化。

進化し続けるソリューション

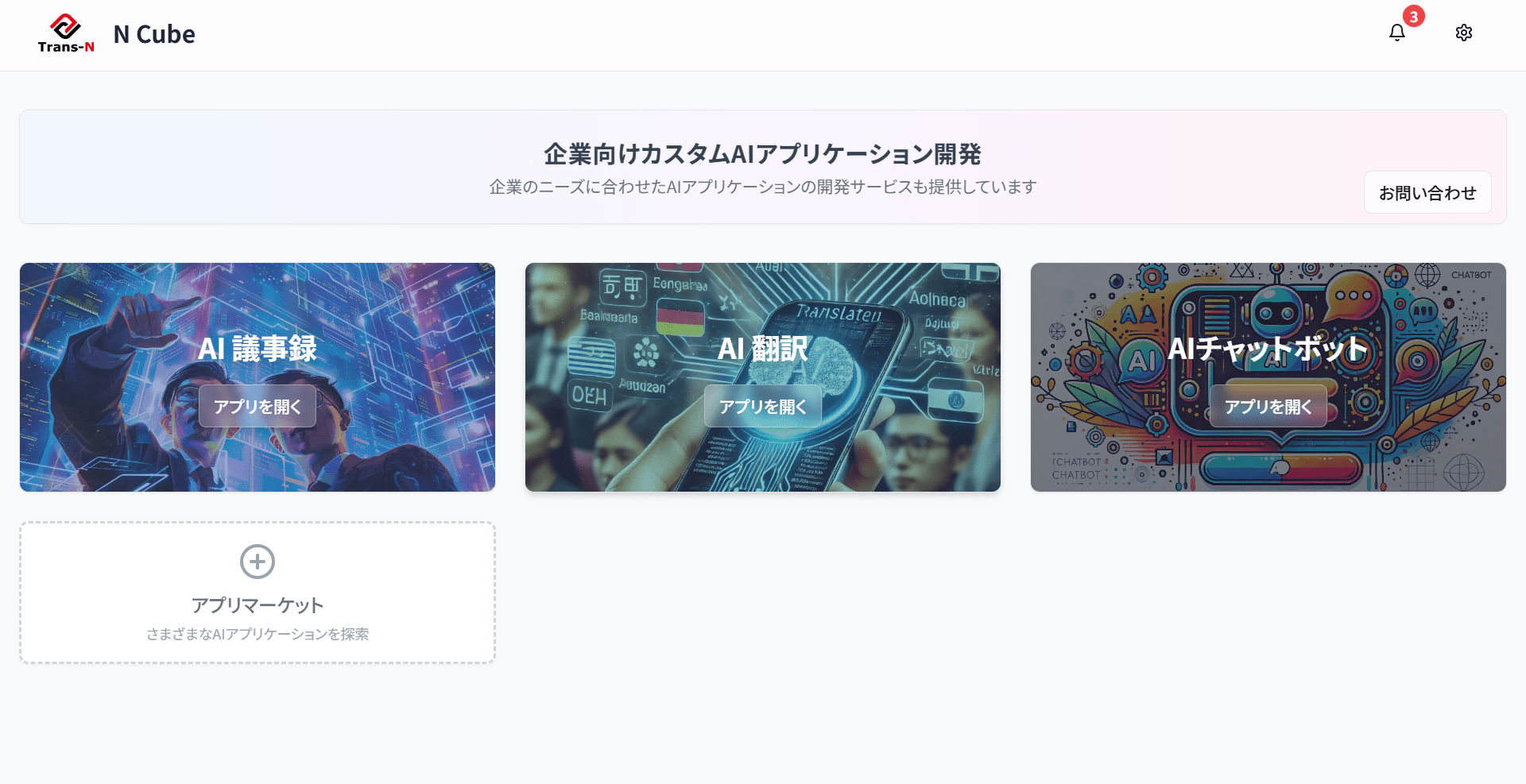

N-cubeプラットフォーム

- 初期搭載されている機能に加え、さまざまなAIアプリケーションを追加する拡張性を備えている。

- またN-Cubeの本体、プラットフォームはオンラインアップデートに対応し、Trans-Nが検証済みの最先端LLM、ワークフロー、ベースシステムをいち早く実装、利用可能。

アプリケーション

Trans-Nチームが厳選した初期搭載アプリケーションにより、「デジタル社員」が即入社。

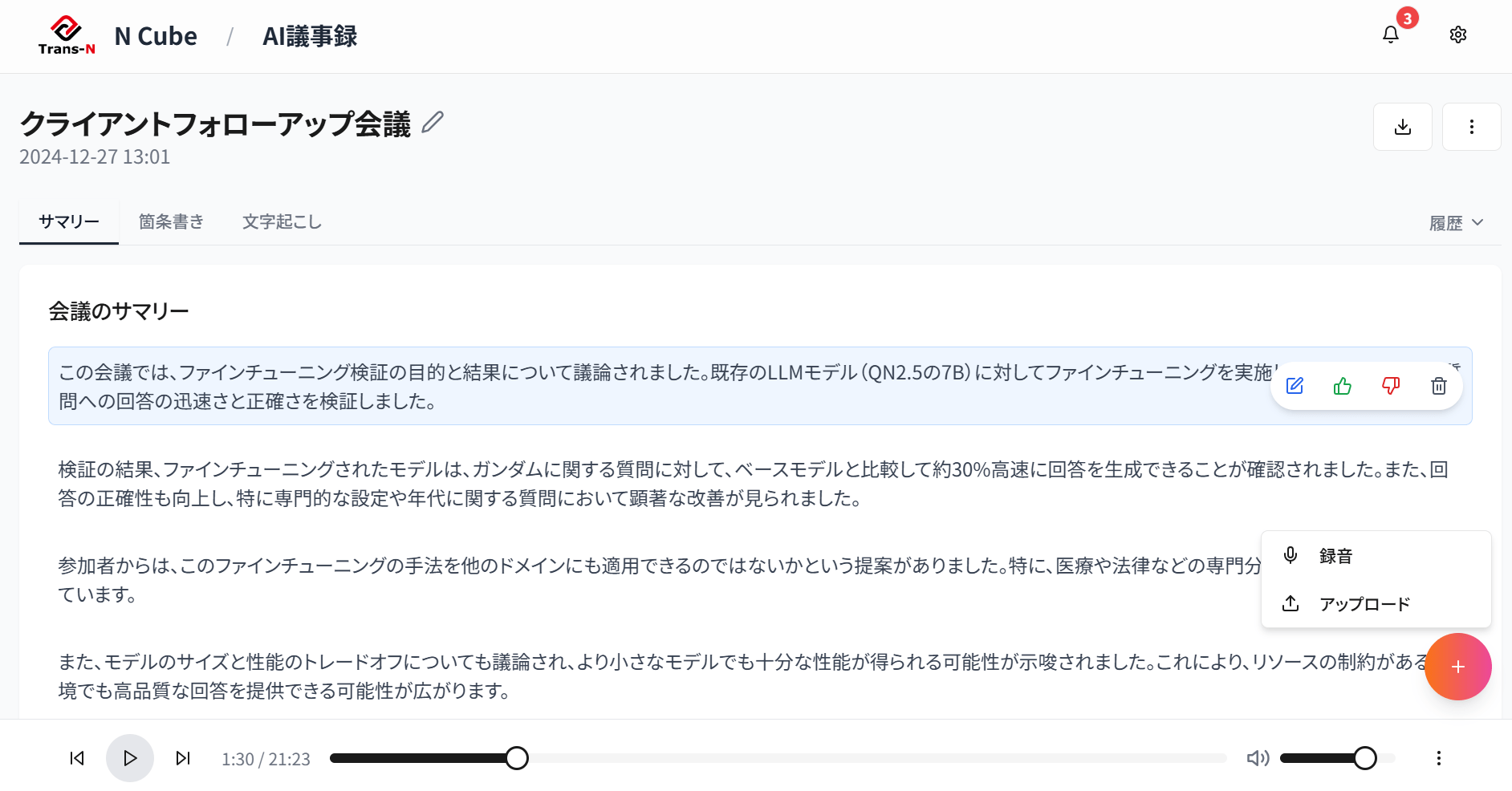

N-Note

戦略コンサルタント監修+post training追加学習可能な

AI議事録

N-Chat

Gemma/Qwen/Deepseekなど最先端のオープンソースLLMを自由に選択し、利用できるAIチャットボット

N-Translate

リアルタイムの翻訳(字幕)や長文翻訳を得意とするAI翻訳

早期購入特典

ご購入、Demoご希望のお客様は以下よりお問い合わせください。

また今なら200万円相当の早期購入特典を獲得できます。

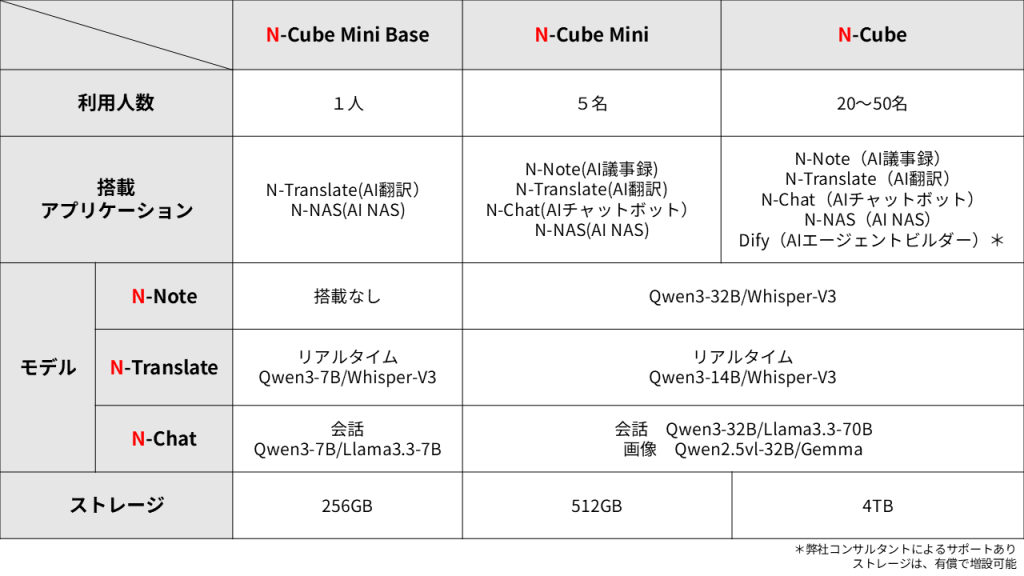

N-Cube シリーズ

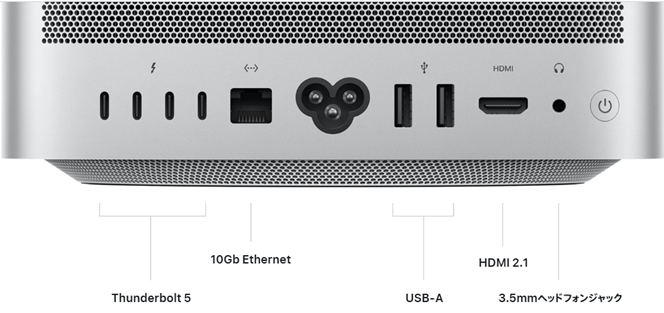

ハードウェア――Mac Studioならではの安心感

AIに特化したハードウェア

Apple M3 Ultraチップ

32コアCPU、80コアGPU、32コアNeural Engine (819GB/sのメモリ帯域幅)

2つのチップを融合させることで、CPU、GPU、Neural Engine、メモリ帯域幅が2倍。膨大なデータセットの高速処理、3Dシーンのアニメーション化とレンダリングの同時実行など、極めて負荷の高いワークフローで突き抜けたパフォーマンスを実感可能。

最大0.5TBのユニファイドメモリによって、大規模言語モデルを完全にインメモリで実行可能。

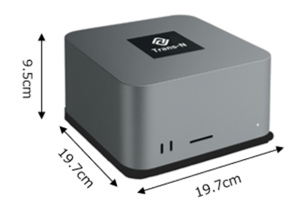

N-Cube Mini

5名前後の小規模専門チーム向け

高専門性チーム用の AI Native サーバー

ローカル環境で稼働するため、

インターネット接続一切不要(オンプレミス環境)

初期搭載アプリケーション

N-Note

戦略コンサル基準の高品質AI会議秘書。会議形式や自社用語にあわせて最適な議事録を作成し、Token制約なく内容を構造化・

整理する。

N-Chat

オープンソースLLMを搭載した生成AIチャットボットを制限なく使用可能

N-Translate

オープンソースLLMを搭載した生成AI翻訳機能を制限なく

使用可能

N-NAS

AIが写真や動画を自然分類し、検索・整理・共有を

スムーズに行う

N-Cube Mini Base

1名用

CXOのPCを代替えする、AI Nativeハイエンドサーバー

ローカル環境で稼働するためインターネット接続一切不要(オンプレミス環境)

搭載アプリケーション

N-Translate

オープンソースLLMを搭載した生成AI翻訳機能を制限なく

使用可能

N-NAS

AIが写真や動画を自然分類し、検索・整理・共有を

スムーズに行う

N-Cubeシリーズの比較表